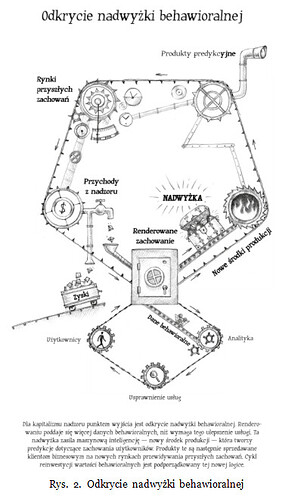

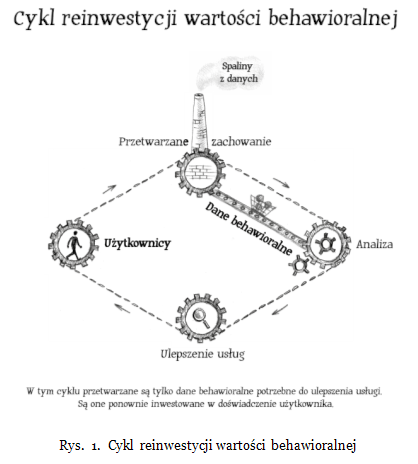

Ekstrakcja danych z tzw nadwyżki behawioralnej to jest skala makro. Z tego nijak nie można dokonać ekstrakcji jednostki. Do tego potrzebne są takie narzędzia jak Pegasus. Inaczej mówiąc, „przetwarzacz” tak ogromnych ilości danych, jakim jest Alphabet, może sprzedać firmom obuwniczym informacje, jakiego rodzaju obuwie będzie modne za pół roku, ale nie jest w stanie podać rozmiaru numeru buta Johna Kowalskiego.

Najpierw przeczytaj. Potem sie wymądrzaj.

„Fachowiec” się znalazł. ![]()

P.S.

Kiedy ja, Kowalski, przegladam online np. buty to przy okazji sprawdzam czy wsród dostępnych rozmiarów jest ten odpowiedni dla mnie. I to wystarczy.

Powinieneś przeczytać rozdział 3 jeszcze raz. Bo najwyraźniej nie do końca rozumiesz jak to działa:

(źródło: „Wiek kapitalizmu inwigilacji”, Shoshana Zuboff, Poznań 2020)

Gdyby się dało udowodnić firmie od wyszukiwarki, że szpieguje konkretną osobę (czyli wiążę i przechowuje dane o tym kto konkretnie ma jaki rozmiar buta), to amerykański system prawny zjadłby ich żywcem - mam na myśli, że posypałyby się pozwy zbiorowe a odszkodowania liczone byłyby w miliardach dolarów.

Przeczytaj te ksiązkę to i info o procesach znajdziesz.

A takzenp. to

„Polityka nadzoru” dla telewizorów — tak, nawet telewizor ma teraz politykę nadzoru — odsłania warstwy działań monitorujących i interesów komercyjnych, które funkcjonują bez naszej świadomości, w naszych czterech ścianach. Samsung przyznaje, że polecenia głosowe mające na celu uruchomienie funkcji rozpoznawania głosu przez telewizor są wysyłane do strony trzeciej, i dodaje: „Proszę pamiętać, że jeśli wypowiedziane przez państwa słowa zawierają dane osobowe lub inne poufne informacje, informacje te znajdą się w przechwyconych danych i zostaną przekazane stronom trzecim za pomocą funkcji rozpoznawania głosu”

/rozdz. 9 „Rendering z głębi”/

Przeczytaj cała ksiązkę. Potem sie wymadrzaj

Proszę, skup się. To nie jest system szpiegowski(*). Tylko narzędzie do prognozowania trendów. Różnica jest taka jak pomiędzy mikroskopem elektronowym a teleskopem Webba.

(*) Co nie znaczy, że analiza zebranych zbiorów danych nie może być używana do OSINT.

Najpierw przeczytaj tę ksiazke zamiast obrazki ogladać, duzo ich w niej nie ma.

Za to czytania sporo.

Zauważyliście, że ChatGPT 4 nagle jakby „zgłupiał”?

Zgadza się. Czytałem o tym już jakiś czas temu i doświadczenie jakby też to potwierdza. Widocznie wszystkie moce poszły w inne zabawki OpenAI.

Edit: możliwe, że OpenAI nie widzi sensu, żeby inwestować dalej w ChatGPT3 i będzie on powoli wygaszany. Na razie działa, ponieważ wiele osób go zna i jest to dobra reklama dla firmy, ale jak długo to będzie miało sens? Za darmo jest Bing Chat również od OpenAI i do tego korzysta z GPT-4.

Wszystkie te zabawki przecież będą głupiały po przekroczeniu pewnego poziomu.

Pewnie widzieliście już filmy generowane przez AI. Do niedawna podsumowywałem je jednym zdaniem „kompletny bajzel”. Dzięki takim narzędziom jak Gen-2 by Runway mogę powiedzieć, że robi się ciekawie

OpenAI pokazała nowe sposoby na korzystanie z ChatGPT4, który teraz do rozmowy potrafi włączać informacje z przesłanych zdjęć https://twitter.com/OpenAI/status/1706280618429141022

Myślę sobie, że coraz bliżej do połączenia tego typu mechanizmów z robotami, w sumie to już się dzieje https://twitter.com/elonmusk/status/1706152105638027515

Z drugiej strony do komercyjnego produktu uniwersalnego robota-pomocy domowej, pewnie jeszcze bardzo daleko, może nawet z 20-30 lat

Użytkownicy ostatnio znaleźli zabawną sytuację, w której neurony Bing Chat nie do końca dobrze stykają ![]()

Kreator obrazów zintegrowany z Bing Chat teraz napędzany jest DALL-E 3 i widać ogromną różnicę. Wcześniej nigdy nie udało mi się zrobić czegoś takiego:

![]()

nie za każdym razem napis wychodzi poprawny, ale we wszystkim co poprzednio widziałem, napisy były totalną fikcją.

Z kreatora można korzystać poprzez Bing Chat albo bezpośrednio na stronie Kreator Obrazów z usługi Microsoft Bing

Znaczny postęp widać również w malowaniu dłoni.

![]()

To prawda, a jak się go odpowiednio zaprogramuje, czyli każe zwrócić uwagę na pewne aspekty, to wtedy wychodzi niemal za każdym razem.

Ale sama rozmowa jest niestety fatalna i do pięt nie dorasta GPT. GPT w starszych wersjach, bo nowsze są głupsze. Zresztą starsze też powoli głupieją.

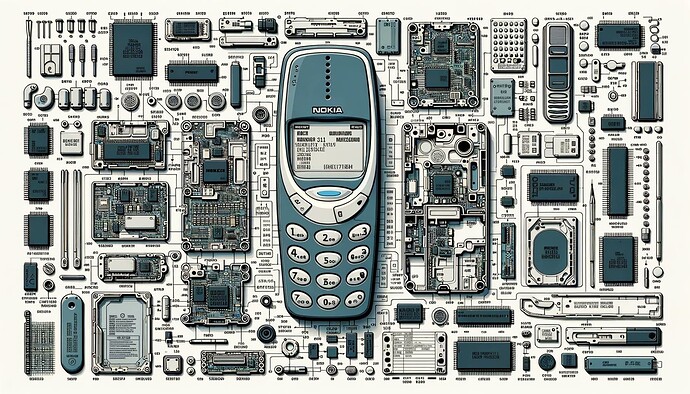

„Wygeneruj rysunek techniczny, który szczegółowo przedstawi rozłożoną na części Nokię 3310. Wszystkie elementy mają pojawić się oddzielnie i być odpowiednio opisane i oznaczone. Cała ilustracja ma być jak najbardziej szczegółowa, precyzyjna i techniczna.”

Nowe idzie. Co ciekawe, w polskiej firmie.

Czyli bing chat korzysta z mocy silnika gpt4? Wiesz może w jakim zakresie? Jak to jest ograniczane? Bo rozumiem, że nie jest to pełnia mozliwości

Piękne ![]()

W sumie to oni tylko kupili robota od Hanson Robotics. Ile w tym marketingu, żeby się mówiło o firmie a ile praktycznego zastosowania, to nie wiem. Jednak nawet jeżeli to zagranie marketingowe to jestem przekonany że doczekamy się czasów, gdy ważne decyzje w firmie będzie podejmowała AI.

Tak, nie wiem w jakim zakresie. Jednak zdaje się że GPT4 ma przewagę Reddit - Dive into anything - jak jest naprawdę nie wiem, to dyskusja z przed 6 miesięcy a w tym czasie mogło się wiele zmienić

ChatGPT4 ma też sporo fajnych funkcji, których Bing nie ma, np możesz poprosić go o coś i dołączyć do tego obrazek. Pytanie może dotyczyć rzeczy, które są na zdjęciu

Piszą, że ChatGPT może widzieć, słyszeć i mówić (obejrzyj sobie dwa filmiki załączone w poniższym artykule):

https://openai.com/blog/chatgpt-can-now-see-hear-and-speak

Myślę ze tak się już dzieje choć nazywamy to inaczej.

Czymze bowiem sa te wszystkie symulacje komputerowe bazujace na szybko zmieniajacych sie danych, wykorzystujace teorię chaosu do prognozowania np. zmian na rynkach walutowych.

Decydentowi pozostaje tylko rzut monetą.

Zgadzam się, coraz więcej danych odnośnie ważnych decyzji dostarczają algorytmy, a może i już po części algorytmy typu AI?

Swoją drogą, nie uważacie że Hanson Robotics potrzebuje lepszego wizażysty? Coś te twarze jakieś dziwne im wychodzą, niby wszystko ok a jakby nie do końca, przynajmniej takie jest moje pierwsze wrażenie

edit: tak sobie przeglądam i większość ‘realistycznych’ robotów wygląda na dziś dzień masakrycznie, ale są takie które wyglądają całkiem fajnie, np

Jak popatrzę na dzisiejsze celebrytki to za bardzo się urodą od Mika nie róznią.