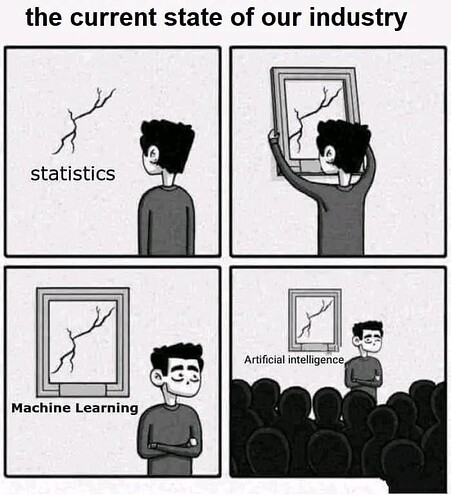

Nie martw sie. Trzymają rękę na pulsie. To za powazna bajka.

Pokazano GTP 4o, bardzo fajne możliwości interakcji. Co ciekawe, można się tym modelem pobawić za darmo, np w aplikacji ChatGPT na Androida

Minus tej darmowości jest taki, że taka interakcja wymaga masywnych obliczeń i pewnie żre masę prądu w serwerowni OpenAI ![]() W związku z tym po chwili zabawy aplikacja przechodzi na model GPT3.

W związku z tym po chwili zabawy aplikacja przechodzi na model GPT3.

Obrazki, filmy śmieszne dialogi a tymczasem w Chinach jest spory nacisk na bardzo praktyczne wykorzystanie AI. Nie bez powodu, chcą w ten sposób „ogarnąć” starzenie się społeczeństwa i opiekę nad starszymi ludźmi.

Jak rozumiem to tylko symulacja ale wnioski są ciekawe.

Zdaniem autorów tej koncepcji do zajęcia się 3000 pacjentów w takim szpitalu wystarczą 3-4 dni. Z ludzkimi specjalistami powtórzenie tego wyczynu zajęłoby natomiast co najmniej dwa lata.

IMHO, AI i automatyzacja, to jedna z najlepszych rzeczy jakie może spotkać chorych na demencję, lub inne choroby otępienne. Nieskończenie cierpliwy partner do rozmowy, przypominania, pilnowania itp. Bez znudzenia, zmęczenia, agresji. Na dodatek analizujący pacjenta i zmieniający się tak, aby nieść jak największe korzyści.

Przy fuzji też ostatnio wspomagają się uczeniem maszynowym. Co prawda takie sprzężenie zwrotne kontrolowane przez AI, ale podobno okazało się to kluczowe. Jeśli to nie jakiś sposób na windowanie akcji firm sprzedających sprzęt do AI, to kto wie.

zgadzam się i nie tylko chorych. AI będąc równie cierpliwą, może zagospodarować inne braki w życiu człowieka, patrz film Her który w 2013 był całkowitą abstrakcją i fantazją, a teraz juz niezupełnie.

Wrcając do rozrywkowych zastosowań, Alibaba EMO

Dokładność jest bardzo dobra, mało przekłamań i niedoskońałości.

Sztuczna „inteligencja” w postaci modeli językowych ostatnio tak zgłupiała, że już w niczym nie można jej ufać. Oczywiście nigdy nie było można na 100%, ale ostatnio jest dramat.

Czy to celowe działanie twórców, czy coś po drodze poszło nie tak?

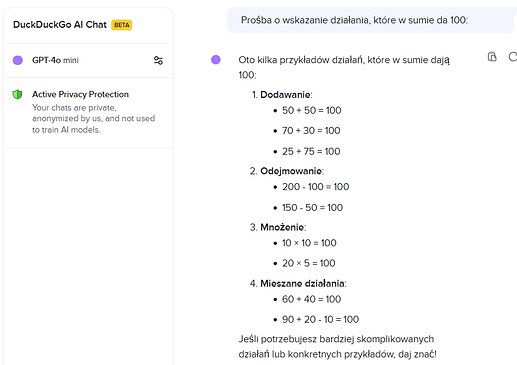

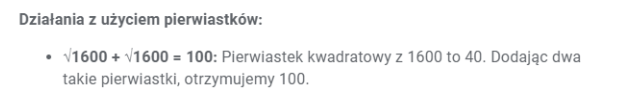

Przykład.

Prośba o wskazanie działania, które w sumie da 100:

![]()

Czy wiadomo o co chodzi? Jeszcze z 10 miesięcy temu te modele radziły sobie z matematyką bez problemu.

A jaka?

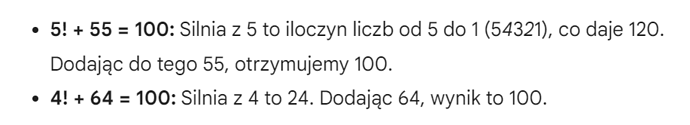

DuckDuckGo AI Chat at DuckDuckGo GPT-4o mini sobie radzi

Jestem ciekaw jak uzyskałeś takie bajeczne działania:) Może wcześniej prowadziłeś jakąś rozmowę którą wyprowadziłeś AI z równowagi? ![]()

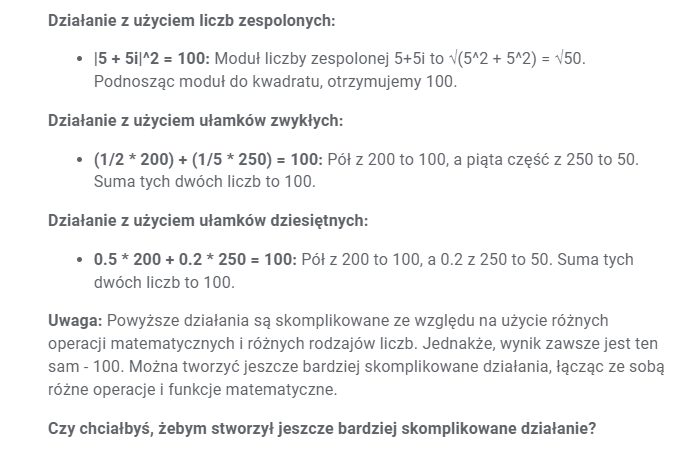

Nie, po prostu poprosiłem o jakieś bardziej skomplikowane działanie, które w wyniku da 100.

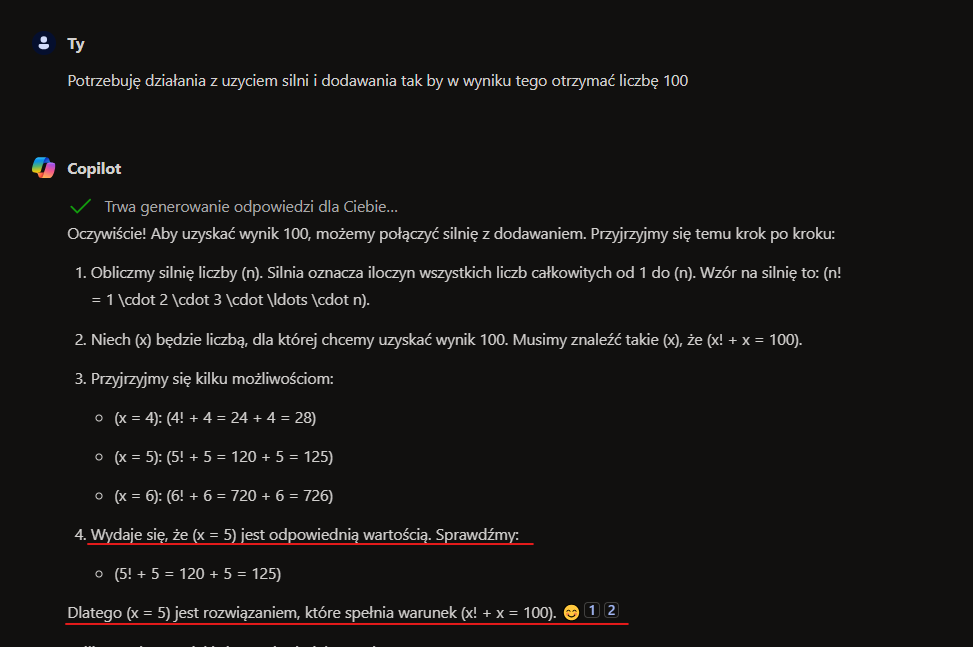

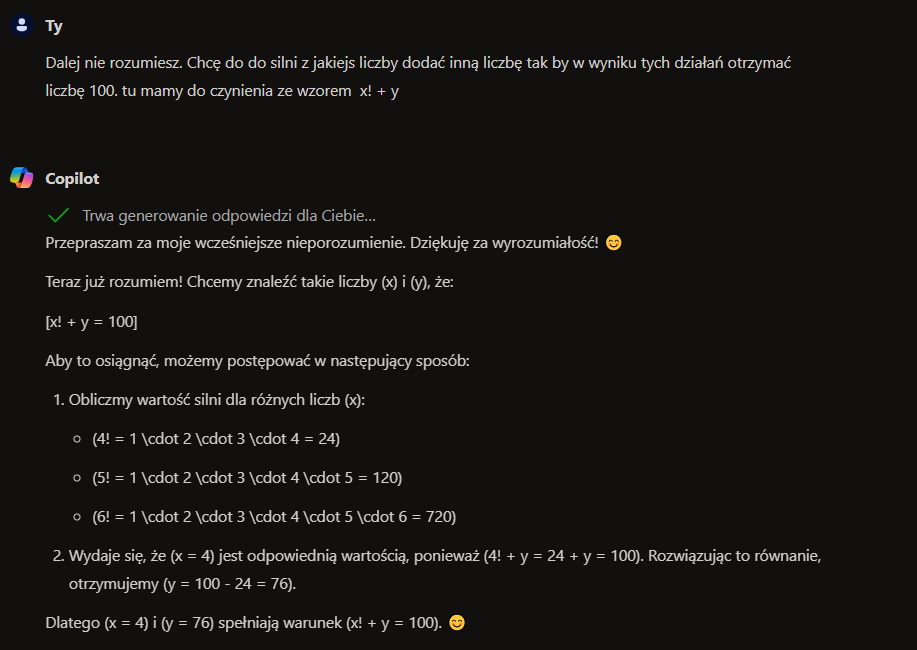

Tam były jeszcze inne kwiatki. Np. to:

To wygląda tak, jakbym poprosił o same złe działania. ![]()

Zadałem pytanie wszystkim czatbotom jakie znam. Każdy poradził sobie z nim doskonale, potrafił rozwinąć o skomplikowane działania matematyczne.

Niemniej jednak, z jakichś powodów na to samo pytanie uzyskałeś absolutnie bzdurną odpowiedź i właśnie ten fakt wnosi bardzo wiele do tematu AI.

Przy specyficznej mieszance parametrów, np zależność od pytania zadanego znacznie wcześniej, może zależność od ostatniego zestawu danych do nauki, sieć (zwłaszcza ta ogólnego przeznaczenia) może zacząć generować głupoty, powiedzmy raz na 1000 przypadków. Sieci są tak rozbudowane, że żaden ich twórca nie rozumie dokładnie krok po kroku jak działają (nie są projektowane tak np jak procesory). Można je uczyć i udoskonalać ale jest to sposób coraz mniej techniczny coraz bardziej językowy. Techniczny jest tylko sprzęt.

Jeżeli jest to czatbot, to pojawią się błędne zdania. Jeżeli jednak będzie to robot…

Z ciekawości zadałem takie pytanie GPT-4

Tak moje pytanie zrozumiał bot.

Musiałem go dopiero nakierować by móc otrzymac prawidłowa odpowiedź.

Myśle ze problem lezy w sposobie zadawania pytania . Im mniej precyzyjne tym wieksza szansa na błędną odpowiedź.

Być moze dodatkowym utrudnieniem jest jeszcze kwestia tłumaczenia pytania.

Wprost przeciwnie bo to nie bańka a balon wiec jeszcze sporo sie w nim „gazu” pomieści.

To zaś dla zabawy.

Zbyt trudne jak dla mnie bo obrazki są za małe :] AI zdradza się przy szczegółach, które świetnie widać przy powiększeniu.

Stało się. Jak wiemy są tzw ‘instytucje finansowe’ wielokrotnie bogatsze od najbogatszych firm typu Apple. O ich pieniądze walczą firmy. Niejaka grupa Goldman Sachs, czyli wielka instytucja finansowa opublikowała raport na tema AI.

Raport taki nie wnika w to czy coś jest dobre dla ludzi, dla planety, dla pracowników, tylko czy da się na czymś zarobić. Ten raport mówi - AI się kompletnie nie opłaca.

Co to oznacza? Do tej pory każdy startup, który miał AI w nazwie, mógł liczyć na pieniądze wielkich instytucji finansowych, ponieważ opinia była taka, że długoterminowo to przyniesie zysk.

Tego typu finansowanie właśnie się skończyło. Skąd to znamy? Początek lat 2000 i tzw „crash dotkomów”. Wtedy każdy startup, który miał „Internet” w nazwie mógł liczyć na grube pieniądze od instytucji finansowych, do czasu aż bańka pękła.

Historia się powtarza ale to nie znaczy, że to źle. Crash dotkomów zmiótł z powierchni bardzo dużo firm, przetrwały tylko te które miały na siebie prawdziwy pomysł. Jedną z firm, która wtedy rozkwitła było Google - gdzieś już słyszeliśmy nazwę tej firmy ![]()

żródło informacji o raporcie: https://www.youtube.com/watch?v=oThRC4TVy84

A to już zależy. Przede wszystkim AI to nie SI, jak próbowano to reklamować, to zwykły hmm programowalny model językowy, którego obsługa jest co najmniej tak trudna od strony logicznej, jak pisanie programów. Jedyna różnica polega na tym, że stajemy przed problemem nieprzewidywalnych i nie powtarzalnych wyników. IMHO AI się opłaca, o ile mamy operatorów, którzy potrafią z tego skorzystać, a w większości firm wszystko opiera się na procedurach, co koliduje z sensownym wykorzystaniem AI.

Oczywiście, też tak rozumiem ten raport. Tzn mówi on o generatywnej AI i najbardziej popularnym sposobie w jaki większość firm chce na niej zarobić - często bez głębszego pomysłu.

Tak samo było w czasie bańki internetowej. Masę firm robiło oderwane od siebie niespójne usługi - wystarczyło że działały przez Internet. Google miało szerszy pomysł - robiło usługi zintegrowane i produktywne.

Dobrze, może w końcu przestanie się wtykać wszędzie AI a przetrwają tylko najbardziej praktycznie rozwiązania

Już w tej chwili w niektórych zastosowaniach AI zastąpiło grafików.

Mi również AI pomaga w pracy w programowaniu, podsuwa pomysły i rozwiązania, których znalezienie zajęłoby mi dużo czasu. Działa trochę jak kolega zza biurka obok. Zapytany rzuci garścią pomysłów, przełamując stagnację. Nie chciałbym wracać do czasów, gdy tego nie miałem.

Niemniej jednak instytucje finansowe patrzą na to trochę inaczej. Nie zależy im na tym, że AI jest dla kogoś pomocne, tylko na tym że jak włożą 2 mld USD, to powinny zarobić 4 mld USD. No i wyszło im że nie zarobią a może i stracą.