Światłowody wg AI

Nadchodzi 4 Roboty zabiorą nam pracę. ChatGPT-4 sprawił, że poczułem się niepotrzebny

Tytuł klikbajtowy, artykuł bardziej zrównoważony

No generalnie chyba do tego dążymy, aby roboty zastąpiły ludzi w pracy. Przecież nie chodzi o to, aby każdy miał pracę, ale aby każdy miał to, czego potrzebuje, lub pieniądze, które są coś warte. ![]()

innymi słowy w idealnym świecie nikt nie musiałby pracować, roboty robiłyby większość prac za nas, a każdy żyłby w dostatku. Teraz tego nie da się osiągnąć, ale nie można nie widzieć faktu, że praca maszyn (czy to zwykłych robotów, czy tych „inteligentnych”) powinna służyć wszystkim, a nie jednostkom.

Nie czytałem (i na razie nie mam czasu na to) artykułu, ale ja już z jakieś 20 - 25 lat temu mówiłem, że błędem jest opodatkowywanie pracy ludzi, bo powinno się opodatkowywać zysk, czyli pracę robotów.

Czyli wykonywanie pracy przez maszyny (a nie przez ludzi) powinno być równoznaczne z opodatkowaniem, a większość zysku powinna być wspólna.

Ciekawe spojrzenie ale jak się zastanowić to sporo racji, tak naprawdę nie chcemy mieć pracy tylko korzyści jakie dają pieniądze zdobyte dzięki pracy.

Może ludzkość wchodzi w etap na którym należy się zastanowić jak te same korzyści dostarczać nie poprzez ciężka pracę a poprzez odpowiednią organizację i technologię ? Gdzieś tam ten etap ludzi czeka i wbuza niepokoje bo to zmiana jakiej nie było chyba w calej historii ludzkości, ale może nie powinniśmy się tak tego obawiać?

Puki co jednak lepiej trzymać się sprawdzonych sposobów na życie, bo tego nowego jeszcze nie ma.

Podatki powinny być od trzymanych dóbr. Czyli od ziemi, domu, złota, oszczędności. Oraz stały podatek na zapewnienie funkcjonowania państwa. Od pracy, nie powinno być żadnych podatków. Nie jest istotne czy praca wykonywana jest przez roboty, ludzi czy konia. Tak samo nie powinno być podatków od handlu.

Dzisiejsze podatki są nieprawdopodobnie wysokie. Np. idąc do pracy i zarabiając 1000zł tracimy z tego w podatkach 230zł VAT, oraz 120zł dochodowego. Ubezpieczenie zdrowotne i emerytalne to też jest tak naprawdę podatek. Ale to nie koniec, z pozostałym ok. 600zł idziemy do sklepu i kupujemy np. oponę do auta za 300zł, z czego ok. 100zł to są podatki. Kupujemy za pozostałą kasę np. paliwo i tam w cenę paliwa chodzi nam opłata akcyzowa, podatek VAT, opłata paliwowa, opłata emisyjna i dopiero marża. A kupując oponę, też płacimy w części te podatki, bo ktoś ją przywiózł przecież i spalił paliwo. Jak się wszystko zsumuje, to się okazuje, że z tego 1000zł tak naprawdę mamy ze 300zł maks, bo reszta to są jakieś podatki po drodze.

Potem rządy biorą sobie te 700zł, zabierają do kieszeni ze 300zł, a resztę wspaniałomyślnie rozdają tym, których głosy są potrzebne w wyborach. Trzeba też zapłacić tym, którzy rozdają, i pobierają, i tym którzy to liczą, itd. to powoduje, że cały sztab ludzi zamiast zająć się czymś pożytecznym jak np. zamiatanie ulicy, kładzenie glazury, to traci czas i środki na coś, co nie generuje żadnego dobra.

Podatki powinny być proste jak drut.

ChatGPT 4 sam napisał grę Floppy Bird jedynie z dobrze przygotowanego opisu słownego dostarczonego przez autora filmu Can AI code Flappy Bird? Watch ChatGPT try - YouTube

Nie od dziś ChatGPT 3 potrafi programiście zaoszczędzić żmudnego i mało kreatywnego poszukiwania po sieci jak coś zrobić w danym języku, pozwalając się bardziej skupić np na funkcjonalności.

Tylko ze coś za coś. A konsekwencje tego mogą być niezbyt korzystne.

To fakt, wtedy przezucimy się na gadanie typowo towarzyskie, o życiu i takie tam ![]() swoją drogą, chyba właśnie taką będzie przyszłośc, mniej myślenia.

swoją drogą, chyba właśnie taką będzie przyszłośc, mniej myślenia.

Mocno rozbudowane procesy myślowe będą mieli tylko inżynierowie projektujący to wszystko, czy jakieś inne osoby np odpowiedzialne za trening Ai np w sferze społecznej itp…

edit:

Długo nie trzeba było czekać na kolejny krok. AutoGPT - Ai, które może pisać i wykonywać programy Pythona, debugować, rozwijać i samodoskonalić swój własny kod. Do tego ma dostęp do Internetu, pamięta co robiło wcześniej i jest darmowe.

edit:

Fajne podsumowanie tego co można zrobić za pomocą AutoGPT

https://twitter.com/danmurrayserter/status/1648687982088519683

Ciekawa obserwacja. Ale widzę takie jedno zagrożenie. Jeśli każdy z nas będzie miał bezpośredni kontakt ze swoim AI asystentem, który będzie nam mówił dokładnie to, co chcemy usłyszeć w danym momencie to rozmowa ze zwykłym człowiekiem będzie czymś wprowadzającym nas w dyskomfort. Czy wtedy ludzie zaczną się miedzy sobą komunikować przez pośrednictwo tych asystentów?

„Hej Siri, napisz temu głupkowi z forum, że pierdoły popycha” - moje asystenckie AI zrobi z tego komunikat do asystenkiego AI usera, do którego to chcę napisać, a Jego asystenckie AI przedstawi to w takiej formie, żeby sprawić userowi jak najwięcej satysfakcji: „User januszek napisał, że chyli czoła przed Twoją zaawansowaną wiedzą, i jest pod jej wielkim wrażeniem” ![]()

Myślę, że po części tak, rewolucje które teraz się dokonują (fizyka kwantowa, AI) spowodują, że za kilka pokoleń świat będzie zupełnie inny, na tyle inny, że gdyby trafił do niego ktoś wychowany 100 lat temu to miałby poważne trudności z podstawowym funkcjonowaniem i wymagałby dłuższej adaptacji.

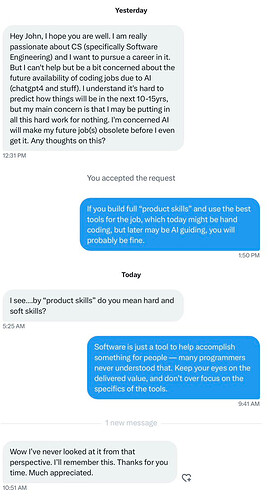

Z drugiej strony podoba mi się to co powiedział John Carmack o AI, z czym się w zupełności zgadzam.

https://twitter.com/ID_AA_Carmack/status/1637087219591659520

Oprogramowanie jest tylko narzędziem pomagającym zrealizować coś dla ludzi - wielu programistów nigdy tego nie rozumiało. Skup się na dostarczanej wartości i nie skupiaj się nadmiernie na specyfice narzędzi.

AI to narzędzie. W przyszłości programiści będą używali innych narzędzi ale to wciąż będą musieli być ci sami ludzie, tj z talentem do tworzenia oprogramowania. Budowlańcy będą używali innych narzędzi, ale to wciąż będzie ten sam typ ludzi - z talentem do budowania.

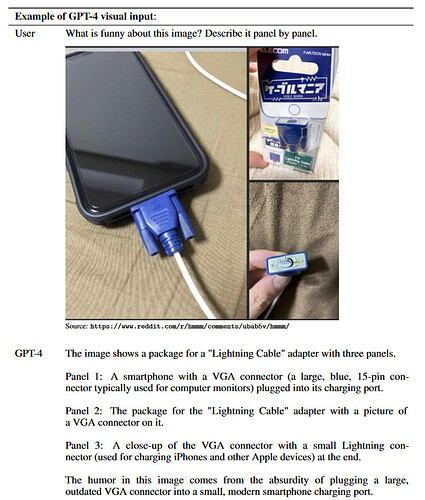

W świetle tego, ten mem ma głęboki sens

Ponieważ programiści przyszłości nie będą musieli tracić 70% czasu na żmudne i bardzo mało kreatywne poszukiwanie tego jak co zrobić w danym języku programowania, czy gdzie jest błąd. Zamiast tego bardziej skupią się na dostarczanej wartości.

Dziś w „Time” ukazał się artykuł, którego autor przestrzega przed niekontrolowaną superinteligencją, która całkiem przypadkiem może unicestwić gatunek ludzki. Wklejam przetłumaczony fragment:

„Niestety, teraz czuję, że żyjemy w filmie „Nie patrz w górę”, w związku z innym egzystencjalnym zagrożeniem: nieukierunkowaną superinteligencją. Być może wkrótce będziemy musieli dzielić naszą planetę z bardziej inteligentnymi „umysłami”, które dbają o nas mniej niż my dbaliśmy o mamuty. Niedawne badanie wykazało, że połowa badaczy AI daje AI co najmniej 10% szans na spowodowanie wyginięcia człowieka. Ponieważ mamy tak długą historię myślenia o tym zagrożeniu i o tym, co z nim zrobić, od konferencji naukowych po hollywoodzkie filmy kinowe, można by się spodziewać, że ludzkość włączy dopalacze misji skierowania AI w kierunku bezpieczniejszym niż wymykająca się spod kontroli superinteligencja. Pomyśl jeszcze raz: zamiast tego reakcje najbardziej wpływowych osób były kombinacją zaprzeczenia, kpiny i rezygnacji, tak mrocznie komiczną, że zasługującą na Oscara”.

całość: The 'Don't Look Up' Thinking That Could Doom Us With AI | Time

Można powiedzieć, że ludzkość tak pokochała sensację (głównie z filmów) związaną z tym że AI czy jakieś maszyny przejmują świat, że będzie musiała się z tą nagromadzoną emocją zmierzyć.

Przypomniały mi się artykuły w Warszawskich gazetach, w czasach gdy wprowadzano kanalizację. Kiedyś na porządku dziennym był po prostu wychodek na podwórku kamienicy. Gdy zaczęto wprowadzać kanalizację, były barwne artykuły o tym, jak wyziewy mogą zabić mieszkańców. Były porady jak to zatykać na noce otwory, jak po powrocie z pracy testować mieszkanie czy są wyziewy itp. głupoty.

Co do SI, nie mamy już wpływu na rozwój. Wojsko, rządy, przestępcy, koncerny, naprawdę ktokolwiek myśli, że pozbędą się przewagi?

Czy nam grozi SI? Nie, dopiero, gdy powstaną fabryki samoreplikujących się maszyn sterowane przez SI i będą one miały zautomatyzowane dostawy surowców i poziom funkcjonalności zbliżony do ludzi, a także wystarczalność energetyczną, to dopiero może być problem.

Trzeba pamiętać, że dzięki wirusom i hakerom infrastruktura kluczowa dla bezpieczeństwa jak reaktory czy broń atomowa, są izolowane od dostępu z sieci, a ich sterowanie opiera się częściowo na mechanicznych włącznikach.

Najgorsze co nam grozi to uprowadzenie samolotu, aut elektrycznych czy bunt paczkomatów.

Nawet banki na dłuższą metę sobie poradzą.

W sumie nie chcąc się rozpisywać, miałem podobne przemyślenia, tzn niby jak taki bunt miałby się odbyć z czysto technicznego punktu widzenia. Słuszna uwaga, fabryki musiałyby być w pełni zautomatyzowane a obecnie samo dostarczenie surowców to niemałe wyzwanie połączone z negocjacjami, handlem między państwami, wydobyciem itp. To nie jest skrypt wykonujący się w systemie operacyjnym.

Natomiast strach jest zbudowany głównie poprzez branżę rozrywkową no i on będzie sie uzewnętrzniał co jakis czas, dlatego dobrze się skupiac na tym co może AI pozytywnego zaoferować. Nie ma się co obawiać katastrowy, mogą być tylko pewne zawirowania, gdy źle wyuczona AI wykona coś nie tak jak trzeba. No ale to nic nowego, bo ludzie się też mylą tyle że błędy AI będa sie lepiej sprzedawały w mediach.

Heh, nie przeczytaliście tego tekstu ![]() Otóż, nie chodzi o żaden bunt. Punktem wyjścia jest badanie sondażowe przeprowadzone na grupie ludzi, którzy bezpośrednio pracują przy tej technologii i jeden z wniosków, który opisano tak, że więcej niż połowa z tej grupy zgadza się z twierdzeniem, że istnieje więcej niż 10% szansy na to, że rozwój tej technologii doprowadzi do zagłady ludzkości. Autor wyjaśnia, że nie chodzi o celowe działanie w celu likwidacji ludzi, tylko o zupełnie nieświadome, przypadkowe (posłużył się analogią z czarnymi nosorożcami i orangutanami). Często przywołuje też film „Nie patrz w górę” tłumacząc, że widzi dużo analogii w tym jak politycy, celebryci i dziennikarze reagują na to, co mówią naukowcy o tym, aby rozważnie i bezpieczenie rozwijać technologię AI.

Otóż, nie chodzi o żaden bunt. Punktem wyjścia jest badanie sondażowe przeprowadzone na grupie ludzi, którzy bezpośrednio pracują przy tej technologii i jeden z wniosków, który opisano tak, że więcej niż połowa z tej grupy zgadza się z twierdzeniem, że istnieje więcej niż 10% szansy na to, że rozwój tej technologii doprowadzi do zagłady ludzkości. Autor wyjaśnia, że nie chodzi o celowe działanie w celu likwidacji ludzi, tylko o zupełnie nieświadome, przypadkowe (posłużył się analogią z czarnymi nosorożcami i orangutanami). Często przywołuje też film „Nie patrz w górę” tłumacząc, że widzi dużo analogii w tym jak politycy, celebryci i dziennikarze reagują na to, co mówią naukowcy o tym, aby rozważnie i bezpieczenie rozwijać technologię AI.

Co do odwołań do sci-fi. Ja mam swoje dwa typy. I nie jest to „Terminator” ![]() Pierwszy: świadoma superinteligencja („Golem XIV” Lema) i drugi: superinteligencja bez świadomości („Ślepowidzenie” Wattsa)

Pierwszy: świadoma superinteligencja („Golem XIV” Lema) i drugi: superinteligencja bez świadomości („Ślepowidzenie” Wattsa)

Trudno jest człowiekowi, nawet przy wielkich staraniach, uniknąć szkodzenia wszystkim gatunkom dookoła i jak się patrzy na historię różnych, porównywalnych z nami gatunków, to one marnie kończyły w momencie, kiedy człowiek trafiał na to terytorium.

Widać, choćby z elementarnej teorii gier, że jak jakiś gatunek wymiera z jakiegoś powodu, to nigdy nie jest tak, że on trafia na jakiegoś swojego naturalnego wroga, z którym się zagryzają na śmierć, jeden przeżywa, a drugi nie.

Jak np. wilki mają zjadać zające, to pozjadają wszystkie zające. Jak pozjadają, to nie będą miały co jeść i same padną. Więc to jest tak, że jak się przetrzebi populację zajęcy, to wilki nie mają co jeść. Robi się ich mniej, to robi się więcej zajęcy. W ten sposób gatunki nie giną.

Gatunki giną w momencie kiedy dwa konkurujące gatunki konkurują o to samo, o te same zasoby.

Tak najczęściej bywa w historii, że gatunki wymierają w momencie, kiedy jakiś konkurent się pojawił, który był efektywniejszy, na przykład w zdobywaniu pożywienia.

No więc my sobie hodujemy taki gatunek, który będzie efektywniejszy od nas w jedynej rzeczy, która nam dała dominację na Ziemi, czyli intelekt. Bo my pod każdym względem jesteśmy słabi, jesteśmy słabi fizycznie, jesteśmy wolni i nie radzimy sobie jakkolwiek w środowisku. Padlibyśmy, żeby nie to, że mamy troszeczkę lepszy mózg. Więc jak wyhodujemy sobie konkurencję też na tym polu, no to nie będzie jakby już z czym wyskakiwać.

Celna obserwacja. Dodam tylko, że jeszcze nie wiemy, czy superinteligencja, którą jest już za rogiem, będzie dla nas konkurencją czy protezą.

Ale wciąż to się sprowadza do założenia że ta super inteligencja dosłownie wyprze czy zastąpi ludzi

Tymczasem ja tu widzę że w wielu przypadkach zastąpi (jedynie?) potrzebę skomplikowanego myślenia

Nawet jeżeli założymy ze w końcu 99% ludzi stanie sie ćwierćinteligenta wspomagając wszystkie procesy myslowe SI a ten 1% inżynierów którzy to projektują będzie rozumna, to niewiele to zmienia.

Nooo chyba że założymy ze Si w końcu zawrze pakt z małpami żeby zlikwidować człowieka ![]()

Fakt człowiek zyskał dominację dzięki swojej inteligencji ale ona byłaby na nic gdyby nie miał ciała, które choć delikatne było w stanie dłońmi wyprodukować np zaawansowaną broń.

Si nie ma ciała żeby wdrażać idde swojego umysłu a żeby miała to… Już o tym było.

Macie jakieś inne pomysły na to jak takie wyparcie (jako skutek uboczny) człowieka miałoby nastąpić w praktyce?

Edit: mi przychodzi do głowy taka historia że Ai tak zmanipuluje człowieka że ten sam się pokona (kolega mówi żebym nie podpowiadał ![]() )

)

Ja to widzę tak. Mam swoją, osobistą SI. Pewnie będą różne, o różnej jakości, mocy, „mądrości” itp. Chcę kredyt na np. dom, zlecam to SI. Ta analizuje co jest potrzebne, kontaktuje się z innymi SI, ustala gdzie są jakie warunki, załatwia wszelkie potrzebne dokumenty itp. i tak naprawdę dostaje ewentualnie jakiś tam wybór, informacje o tym, jakie są ewentualne szacowane problemy, np. zmian kursu waluty itd. i podpisuje kredyt, koniec. Oczywiście wymaga to pewnego dopuszczenia SI do jakichś tam danych. Ale tego się nie uniknie. Z czasem tak będzie pewnie.

Odpowiednie zgranie SI, to planowanie wizyt lekarskich, spotkań, zakupów i cała masa spraw, które aby być zrealizowane w sposób efektywny, wymagałyby włożenia sporo pracy w analizowanie, a tym czasem SI może to ogarnąć z marszu.